En los últimos años hemos sido testigos de la importancia que el tema de la inteligencia artificial ha adquirido en el campo de la retina. No hay congreso de la especialidad en el que no se incluya alguna ponencia o incluso alguna sesión completa a presentar los avances que esta rama de la informática ofrece en nuestra profesión. Pero, ¿Cómo consiguen esos programas diagnosticar mejor que un retinólogo una retinopatía diabética o predecir la respuesta al tratamiento antiangiogénico antes de inciarlo? En estas serie de entregas del blog me gustaría explicar de forma simple, al menos eso espero, como funciona la inteligencia artificial.

Cuando escuchamos el término inteligencia artificial a muchos nos puede venir a la mente la imagen que en Hollywood nos han vendido durante varias décadas en la que, robots inteligentes deciden tomar el control del mundo cuando se dan cuenta del peligro que los humanos suponemos para nosotros mismos y para el planeta.

Aunque esta versión sobre la inteligencia artificial está muy bien para una tarde de cine, en realidad se aleja mucho de lo que es la inteligencia artificial en este momento e incluso de lo que creo que llegará a ser en el futuro, al menos eso espero.

Aunque el término inteligencia artificial suena a algo muy moderno y futurístico, en realidad debemos remontarnos hasta finales del siglo XIX para encontrar los orígenes de esta fascinante herramienta. En 1874 el matemático inglés George Boole, publicó The Mathematical Analysis of Logic, en donde propuso utilizar las herramientas del álgebra para sistematizar el razonamiento lógico. Esta proposición permitió establecer lo que hoy se conoce como funciones boolenas, basadas en el uso de valores binarios 0 y 1, que como sabemos componen el lenguaje hablado por los ordenadores. Utilizando las bases lógicas establecidas por Boole, pensadores tan conocidos como Alain Turing (creador del concepto de algoritmo y considerado el padre de la informática), o Konrad Zuse, (creador de la primera computadora programable y completamente automática de la historia), continuaran el camino iniciado por el matemático inglés y permitieron que en 1956 John McCarthy acuña por primera vez el término Inteligencia Artificial durante la famosa conferencia de Darmouth. Según McCarthy, todos los aspectos del aprendizaje o cualquier otro rasgo de la inteligencia pueden, en principio, ser descritos de una forma tan precisa que se puede crear una máquina que los simule. Este es el concepto fundamental detrás de todos los avances que desde entonces han llevado a que la inteligencia artificial pueda, por ejemplo, decirnos el sexo o la edad de un paciente a través de una retinografía.

Redes neurales

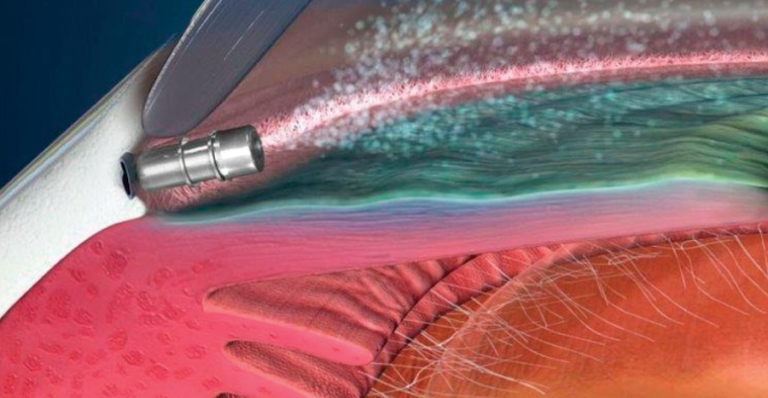

Si los procesos naturales de pensamiento y aprendizaje tienen su base biológica en el cerebro, es lógico pensar que los sistemas de la inteligencia artificial busquen imitar el comportamiento de las neuronas y sus complejas redes de interconexiones. Al igual que las neuronas humanas, las neuronas artificiales reciben información a través de una o varias señales de entrada procedentes de otras neuronas o del exterior. Estas señales se encuentran moduladas por un factor llamado peso, que determina la importancia de la conexión existente entre la neurona receptora y el emisor de la señal. El procesamiento que se realiza dentro del soma o cuerpo de la neurona artificial, es la suma ponderada de la información de entrada. Decimos que esta suma es ponderada porque cada valor de entrada se multiplica por su respectivo peso. Al resultado de esa suma se le aplica una función no lineal, la función de activación, lo cual permite comparar el computo obtenido con un umbral. Si el resultado supera ese umbral, la salida toma un valor igual o cercano a 1, y por tanto la neurona envía una señal de activación. Por el contrario, si el resultado de la suma ponderada no supera el umbral, el valor que emite esa neurona será igual o cercano a 0, lo cual mantendrá a la neurona en un estado “inactivo”. El hecho de que una neurona se active o no en respuesta a un estímulo resulta muy importante durante los procesos de machine learning, y es que muchos algoritmos de aprendizaje se basan en el modelo Hebbiano, según el cual el peso de la sinapsis entre dos neuronas se incrementa si las dos neuronas se activan simultáneamente y se reduce si se activan por separado.

Al igual que ocurre a nivel cerebral, la verdadera capacidad de procesamiento de la información de los sistemas de inteligencia artificial, está determinado por la acción paralela de múltiples neuronas interconectadas entre sí, lo que se conoce como redes neuronales. El número de neuronas que compone cada red, la complejidad de sus interconexiones y la arquitectura de las mismas está determinada por el tipo de problemas que se busca resolver. Lo que es común a todas las redes neuronales, es la agrupación de sus neuronas en capas (cada una con un número variable de neuronas interconectadas). La capa de entrada es la encargada de recibir la información desde el exterior y la transmitirla a una o varias capas intermedias, cada una conectadas a la capa inmediata posterior de forma total o parcial, a excepción de la última capa que constituye la salida final de la red neuronal.

Creo que entre historia y matemáticas esta entrada habrá dejado a más de alguno dormido, así que no me alargo más y si os parece interesante, en la siguiente entrega explicaré cómo funciona el machine learning.

Dr. Saenz de Viteri